AI-Vishing: что это и чем может угрожать компаниям

Изображение: recraft

Всё больше российских компаний сталкивается сегодня с кибератаками, применяющими подделку голоса. В первой половине 2024 года количество инцидентов с использованием AI Vishing увеличилось на 442% по сравнению с аналогичным периодом прошлого года. Такой резкий рост объясняется стремительным удешевлением технологии использования и доступностью нейросетей, способных подделывать голос. В данном материале Никита Боловин, специалист по кибербезопасности RTM Group, расскажет об особенностях атак данного типа и о том, как организации разного размера могут защититься от опасности.

Что такое AI—Vishing?

AI Vishing — это вектор атаки методами социальной инженерии, где основным способом получения информации злоумышленниками становится подделка голоса. Его цель — обманным путем завладеть доступом к конфиденциальным данным (персональной информации, финансовым реквизитам или учетным записям). Злоумышленники создают иллюзию срочности или важного поручения, чтобы подавить бдительность жертвы и вынудить ее раскрыть конфиденциальные сведения. Усыпить бдительность жертв им помогают реалистичные аудио-дипфейки с голосами конкретных людей: коллег, начальников, партнёров.

Вишинг особенно опасен потому, что с его помощью киберпреступники могут обходить традиционные технические средства защиты, такие как:

- Антифишинговые фильтры.

- Межсетевые экраны.

- Системы обнаружения вторжения (IDS/IPS).

Атака нацелена не на уязвимости ПО, а на человеческий фактор, что делает ее одной из наиболее серьёзных угроз для информационной безопасности и бизнеса.

Благодаря возросшему распространению и совершенствованию технологий изменения голоса на основе ИИ, любой может клонировать чужой голос, используя простой 10-15-секундную аудиодорожку. Как утверждает Microsoft, это реально сделать сегодня за 3 секунды. Неудивительно, что злоумышленники уже начали использовать данные инструменты для создания продвинутых и целенаправленных вишинг-атак.

Ущерб от атак с использованием AI-Vishing

Ниже перечислим самые успешные кейсы атак с применением AI Vishing.

В Telegram злоумышленники взламывают аккаунт жертвы и рассылают её контактам сообщения с просьбой занять или перевести деньги, подкрепляя запрос «голосовым» сообщением якобы от имени владельца аккаунта. По информации РБК, в одном случае мошенники пытались получить 200 тыс. руб.

Киберпреступники создали фейковый аккаунт губернатора Ярославской области и сымитировали его голос с помощью нейросети. Затем они звонили депутатам облдумы, выдавая себя за губернатора Михаила Евраева.

Транснациональный пример мошенничества. Японский банкир получил звонок от американского инвестора, который просил перевести деньги для покупки стартапа. В итоге ущерб составил $35 млн. Отсюда можно сделать вывод, что в дальнейшем ИИ будет только улучшать вишинг-атаки.

Как собираются данные о жертве?

В AI Vishing ключевым является клонирование голоса жертвы или её близких с помощью систем синтеза речи. Злоумышленники либо добывают образцы голоса из открытых источников (видеозаписей, социальных сетей) или записывают его под предлогом опроса. Также преступники могут пытаться найти необходимые элементы для создания дипфейка здесь:

- Социальные сети и видеохостинги.

- Взлом мессенджеров и сбор голосовых сообщений.

- Открытые вебинары и записи с конференций.

- Утечки баз данных телефонных разговоров.

- Целенаправленный звонок жертве (поэтому не стоит никогда разговаривать с мошенниками, лучше сразу отключаться).

Технологии ИИ в основе AI Vishing?

Процесс современного клонирования голоса включает запись и обработку аудио, а также обучение модели. Последнее основано на мощных библиотеках и алгоритмах с открытым исходным кодом, которых сегодня существует множество. Получив первые образцы и при необходимости совершенствовать их, злоумышленники изучают речевых качества человека, за которого они выдают себя, и даже пишут сценарий перед проведением атаки.

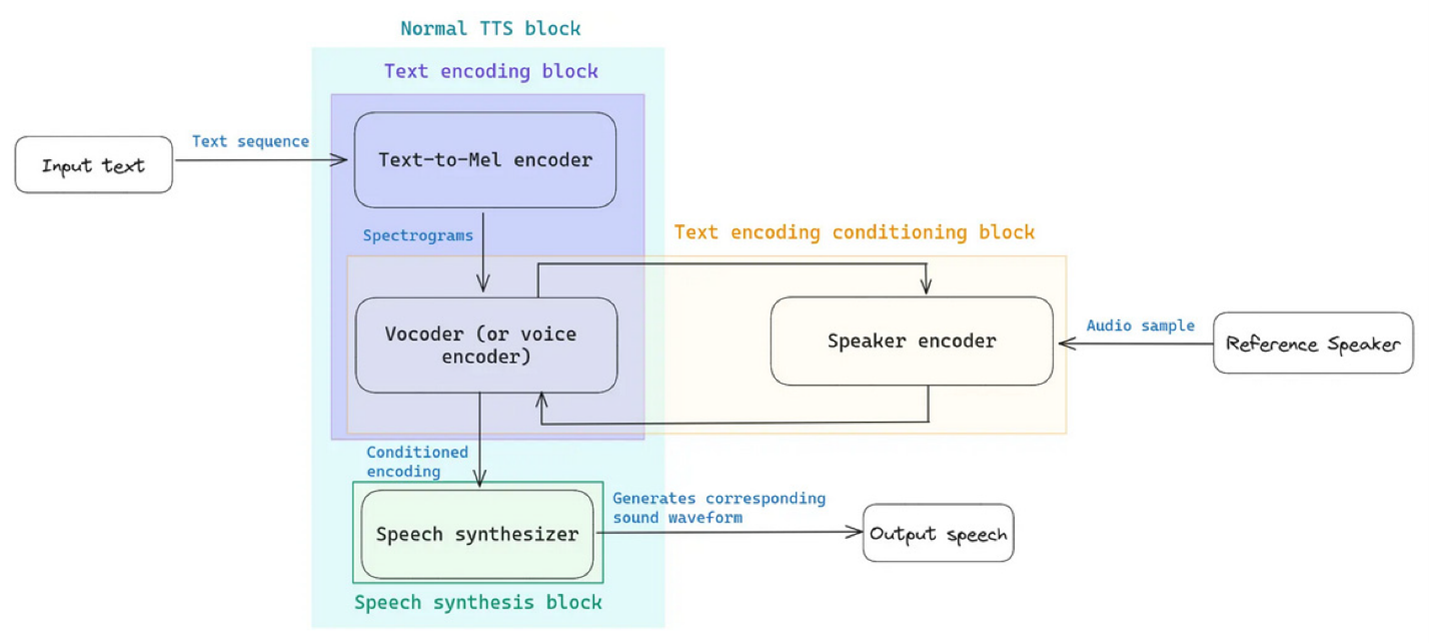

Для генерации голоса с помощью ИИ используется технология, которая называется синтезом текстовой речи (TTS) На рисунке 1 мы видим, как система TTS преобразует текст в аудио-фрагмент, чтобы воспроизвести голос конкретного человека. При этом алгоритмы способны даже менять интонацию, имитировать эмоции, речевые особенности. Это создает иллюзию реального звонка от конкретного человека. Это резко повышает доверие жертвы и снижает вероятность возникновения сомнения при таких ситуациях.

Современные злоумышленники при атаках вишинга используют:

- Спуфинг номеров — подделку телефонных номеров, включая номера коллег или руководства;

- Дипфейки голосов — создание реалистичных голосовых имитаций на основе публично доступных или украденных при угоне аккаунтов в мессенджерах аудиозаписей;

- Имитацию голосовых характеристик в реальном времени с помощью ИИ.

Под давлением страха или волнения жертва может раскрыть запрашиваемые данные — например, логин, пароль, PIN-код или другую конфиденциальную информацию. Получив такие сведения, злоумышленник способен совершить кражу личных данных, несанкционированные операции или получить доступ к различным защищённым сервисам.

Типичный сценарий атаки AI Vishing

Получив достаточно информации, злоумышленник связывается со своей потенциальной жертвой. Чаще всего посредством телефонного звонка, в процессе которого он старается выглядеть максимально убедительно. Поддельный номер, который отображается как номер известной компании или коллеги, и измененный голос — всё это делает разговор правдоподобным. Современные технологии позволяют не только имитировать чужой голос, но и создавать целые аудиозаписи с клонированной речью, так что отличить подделку становится почти невозможно.

Чтобы разговор не вызывал подозрений, злоумышленник создает ситуацию, которая требует срочной реакции. Это может быть «просроченный платеж», «подозрение на взлом аккаунта» или любая другая история, в которой промедление якобы грозит серьезными последствиями. Давление усиливается эмоциональной манипуляцией: на жертву воздействуют страхом, чувством ответственности или, наоборот, стараются вызвать доверие, представляясь коллегой, которому срочно нужна помощь.

Если человек «попадается» на эту уловку, он сам передает преступнику нужную информацию, которая поможет ему для реализации следующих этапов атаки. В дальнейшем эти данные могут быть применены для кражи денег со счетов или других финансовых махинаций.

Методы защиты от AI Vishing

Для предотвращения угроз использования AI Vishing необходимо проводить инструктаж сотрудников. А также мероприятия, схожие с действиями злоумышленника, чтобы сотрудники имели реальное представление о существовании и методах атак вишинга с использованием ИИ. К основным инструментам защиты от AI Vishing относятся следующие:

- Системы фильтрации голосовых вызовов, блокирующие подозрительные звонки до того, как они достигнут сотрудников, используя проверки репутации номеров, голосовые CAPTCHA и списки разрешённых/запрещённых номеров.

- Системы обнаружения мошенничества в реальном времени, которые анализируют звонки на наличие признаков вишинга, включая использование эвристик и поведенческого анализа.

- Интеграцию с SIEM и XDR для записи голосового трафика и его анализа в рамках общей системы безопасности

Сотрудники, занимающие ответственные должности, должны быть крайне осторожны в отношении срочных звонков, требующих немедленного действия, особенно когда звонящий запрашивает финансовую или конфиденциальную информацию, например, одноразовый пароль (OTP).

В конечном итоге инструменты управления мобильными устройствами предлагают технологии, помогающие проверять звонящих, например, корпоративные MDM‑решения. С их помощью можно выяснить, действительно ли номер и голос за ним принадлежат тому, за кого себя выдают. В то же время организациям следует рассмотреть возможность реализации требования о том, чтобы все конфиденциальные разговоры осуществлялись через каналы корпоративного чата, где требуется строгая аутентификация.

Исследования и инструменты активно разрабатываются для помощи в обнаружении. Их точность иногда под сомнением, хотя в целом они могут быть полезны для голосовой почты или офлайновых голосовых заметок. Возможности обнаружения будут улучшаться со временем и в итоге их начнут встраивать в поддерживаемые корпоративные инструменты.

Заключение

Таким образом, AI Vishing – серьёзная современная угроза, сочетающая технологии глубокого синтеза речи и традиционные приёмы социальной инженерии. Клонирование голоса по короткому образцу становится реальностью: научные модели VALL-E, Tacotron 2, VITS и коммерческие решения ElevenLabs позволяют практически мгновенно получить «копию» почти любого голоса. В 2025 году в России появились первые истории пострадавших: от фейковых соцопросов до телефонных вымогательств посредством клонированного голоса.

Главная защита – бдительность. Когда речь идет о переводах денег, всегда стоит перепроверять информацию несколькими способами, не полагаясь исключительно на голос собеседника.