Эксперт Михаил Черешнев: утечка Claude Code демонстрирует, что главной угрозой ИИ-проектов остается человек

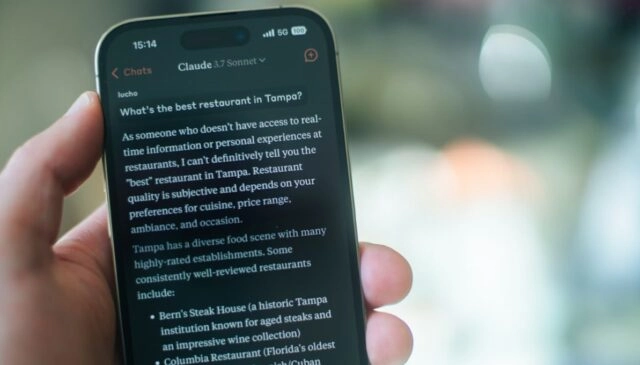

Изображение: Aerps.com (unsplash)

Ведущий инженер по ИИ и безопасности ГК Swordfish Security разобрал инцидент с утечкой исходного кода ИИ-ассистента от Anthropic.

Недавний инцидент с утечкой исходного кода Claude Code — CLI-ассистента от компании Anthropic — вызвал широкий резонанс в сообществе. В открытый доступ попали не просто фрагменты кода, а ключевые механизмы управления моделью. Для рынка это событие стало серьезным сигналом: даже самые продвинутые AI-системы остаются крайне уязвимыми перед лицом человеческого фактора.

Проблема не в модели, а в операторе

Кейс Claude Code наглядно демонстрирует: современные системы генеративного ИИ создаются и эксплуатируются в тесной связке с человеком. И практика показывает, что критические сбои чаще всего происходят не из-за «галлюцинаций» или внутренних багов нейросети, а из-за банальной невнимательности и нарушения инженерной дисциплины на стороне оператора.

Даже самые сложные алгоритмы, отвечающие за имитацию «разумного» поведения ИИ, мгновенно компрометируются, если человек-оператор пренебрегает протоколами безопасности. Сегодня мы видим, что риски ИИ-агентов часто обусловлены отсутствием у них долгосрочного контекста задачи. В отличие от опытного инженера, который годами накапливает понимание архитектуры и критических зависимостей системы, ИИ работает в рамках заданного окна контекста. Ответственность за сохранение этого «смыслового каркаса» лежит на человеке.

Причиной утечки в данном случае стало не несовершенство технологий Anthropic, а некорректная и, в некоторой степени, безответственная работа оператора. Это подчеркивает критическую необходимость развития глубоких инженерных компетенций именно у тех специалистов, которые используют ИИ для решения бизнес-задач.

Как минимизировать риски: дорожная карта для компаний

Чтобы внедрение ИИ не превратилось в «мину замедленного действия» для безопасности продукта, компаниям необходимо упорядочить подход к управлению разработкой.

На основе нашего опыта в Swordfish Security, я выделяю четыре критических шага для обеспечения безопасности при работе с LLM-инструментами:

- Классификация систем по уровням критичности и допустимости использования ИИ. Необходимо четко определить, в каких сегментах инфраструктуры использование ИИ-ассистентов допустимо, а где — категорически запрещено.

- Ограничение применения ИИ без обязательного ревью со стороны архитекторов и специалистов по безопасности. «Слепое» доверие к выводу модели — прямой путь к уязвимостям.

- Системное развитие компетенций сотрудников в работе с ИИ. Сотрудники должны понимать не только возможности промпт-инжиниринга, но и векторы атак на LLM, а также знать границы ответственности.

- Формализация политик использования ИИ внутри компании. Важно разработать и внедрить внутренние регламенты, описывающие легальные инструменты, способы передачи данных и методы проверки результата.

Утечка Claude Code — это важный урок для всей индустрии. ИИ может значительно ускорить написание кода, но он не может заменить ответственность инженера.